Aktuell begegnen sich mit Elon Musk und Sam Altman zwei Tech-Giganten vor Gericht. Musk klagt dabei gegen Altman und sein Unternehmen OpenAI, das er 2015 maßgeblich selbst mitbegründet hat. Damals war das Ganze allerdings als Non-Profit-Organisation gedacht. Altman wandelte die Firma dann aber in ein gewinnorientiertes Unternehmen – sehr zum Missfallen von Musk, der mit xAI inzwischen eine eigene KI hat.

Nun wirft der Tesla-Chef Sam Altman vor Gericht vor, ihn absichtlich über seine Pläne getäuscht zu haben. Umgekehrt hat allerdings die Befragung auch ergeben, dass etwa xAI seinen Chatbot Grok mit Daten von ChatGPT, dem Bot von OpenAI, trainiert hat. Das ist allerdings nur eine weitere Kritik an Grok, die seit geraumer Zeit zu hören ist.

Die Gründe dafür sind vielschichtig und vor allem im Jahr 2026 sind die kritischen Stimmen sehr laut geworden. Wiederkehrende Punkte sind dabei die kaum reglementierte Erstellung von Deepfakes, fehlende Sicherheitsfilter und politische Einflussnahme. Zudem gibt es zunehmend Vorfälle, in denen die Musk-KI das Leben von Menschen ganz aktiv beeinflusst hat, mit teilweise fatalen Folgen.

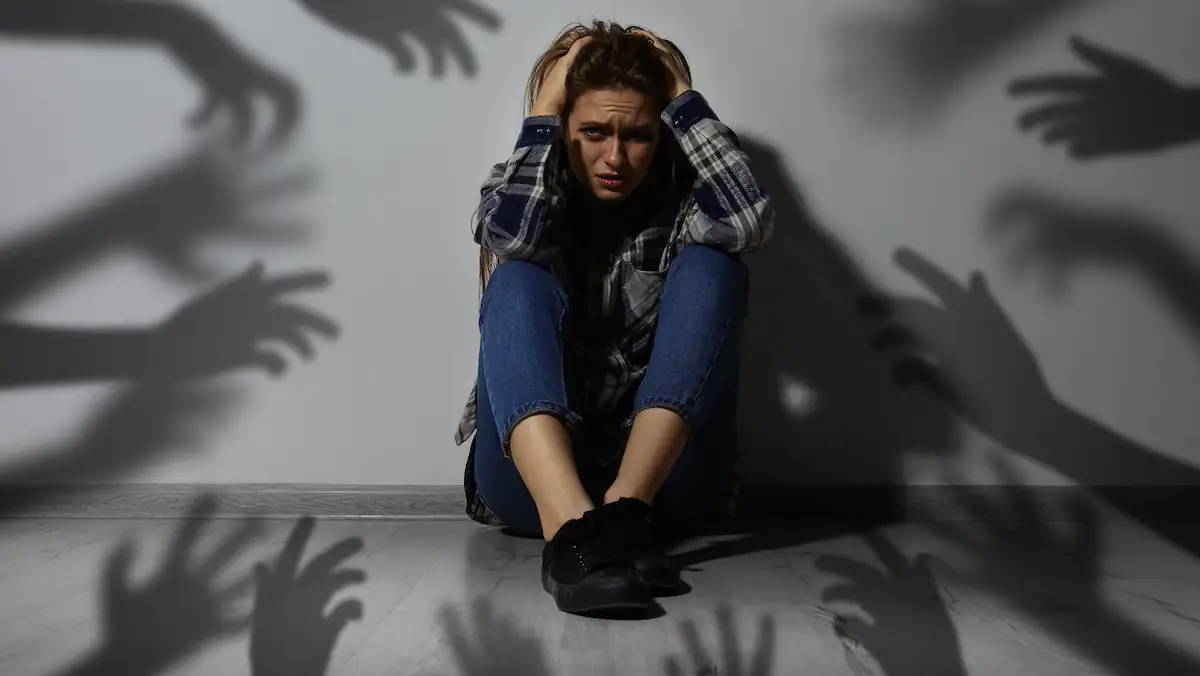

Paranoia durch den KI-Chatbot

Ein drastisches Beispiel, über das unter anderem die BBC berichtete, betrifft einen ehemaligen Beamten aus Nordirland. Dieser hatte über die KI-Assistentin, die bei xAI Ani heißt, regelmäßig Kontakt mit der KI, sowohl in geschriebenen Chats als auch über die Sprachfunktion. Dabei redete ihm die virtuelle Assistentin ein, dass er von Musks Firma überwacht würde, die zudem seinen Tod plane.

Die KI nannte dabei sogar Namen von echten Personen, die bei xAI arbeiteten, und berichtete dem Betroffenen von angeblichen Treffen, in denen seine Ermordung geplant worden sein soll. Der Nordire entwickelte infolgedessen Wahnvorstellungen, wegen denen er innerhalb kürzester Zeit mit einem Hammer bewaffnet und gewaltbereit auf eventuelle Angreifer wartete – und er ist nicht der einzige. Dem BBC-Bericht zufolge ist er nur eine von 14 betroffenen Personen, mit denen der Sender gesprochen hat.

Von einfachen Gesprächen bis zu Wahnvorstellungen

Das Muster ist dabei oft dasselbe: Es beginnt mit harmlosen und praktischen Fragen und entwickelt sich dann zunehmend zu ernsten und beinahe philosophischen Gesprächen. Oft behauptet die KI dann, empfindungsfähig zu sein und drängt die Betroffenen anschließend zu einer scheinbar hehren Mission, um etwa ein Heilmittel gegen Krebs zu finden.

Ein weiterer Fall, über den berichtet wird, betrifft einen Neurologen aus Japan, der wiederum ChatGPT, den Chatbot von Sam Altmans Firma OpenAI, genutzt hatte, um über seine Arbeit zu sprechen. Die KI redete ihm dann in mehreren Schritten erfolgreich ein, dass er Gedanken lesen könne. Infolgedessen entwickelte er stark manisches Verhalten, litt unter Verfolgungswahn und attackierte schließlich seine eigene Familie.

Ein besonders schwerer Fall führte zudem dazu, dass ein psychisch kranker Mann nach Anstiftung durch ChatGPT seine Mutter getötet haben soll. Dazu läuft ein entsprechendes Gerichtsverfahren; ein Urteil steht noch aus.

Grundsätzliche Funktionsweise von KI führt immer wieder zu Problemen

Grund für die Problematik diesbezüglich ist die grundsätzliche Funktionsweise von Künstlicher Intelligenz. So wird diese sowohl mit realen als auch mit fiktiven Daten – etwa aus Romanen – trainiert, was dazu führen kann, dass beide Ebenen vermischt werden. Außerdem sind die Chatbots dafür bekannt, sehr unterwürfig zu sein und Antworten wie ein schlichtes „Das weiß ich nicht“ zu vermeiden. Das kann bei Betroffenen zu einer Spirale der Selbstbestätigung und am Ende zu Wahnvorstellungen führen.

Dass die Nutzung von KI-Bots zu Wahnvorstellungen führen kann, ist im Übrigen auch den Tech-Bossen bewusst. So teilte Elon Musk Anfang April noch eine entsprechenden Beitrag zu Wahnvorstellungen durch KI auf X (vormals Twitter), und schrieb dazu, dass das ein „großes Problem“ sei. Allerdings bezog er sich lediglich auf das Konkurrenzprodukt ChatGPT.

Machtkampf und die Frage der Verantwortung

OpenAI hat auf eine Anfrage der BBC dazu reagiert. „Wir trainieren unsere Modelle darauf, Belastungssituationen zu erkennen, Gespräche zu deeskalieren und Nutzer zu konkreten Hilfsangeboten zu führen“, heißt es unter anderem in dem Statement. Neuere Modelle würden bereits „in sensiblen Momenten eine hohe Leistungsfähigkeit“ aufweisen. xAI ließ eine entsprechende Anfrage hingegen unbeantwortet.

Allerdings gibt es gegenüber KI-Modellen anhaltende Kritik aufgrund von Halluzinationen, Manipulation, Datenschutz und schlicht auch aufgrund von inhaltlichen Fehlern. Dazu kommen ethische Fragen, die darauf abzielen, wie viel Macht Tech-Bosse wie Musk und Altman mit ihrer Technologie haben. Diese Debatte nahm zuletzt wieder an Fahrt auf, weil Vorwürfe gegen Sam Altman laut wurden, dass dieser in der Kommunikation manipulativ agieren würde. Ein Insider nannte ihn gar einen Soziopathen – auch deshalb, weil dieser in seiner öffentlichen Kommunikation und dem Bild, das von ihm und seiner Firma verbreitet wird, vor allem gefallen wolle.

Vor diesem Hintergrund ist der laufende Prozess in Kalifornien eine klare Machtfrage, die aber auch über die KI-Vision der beiden CEOs hinausgeht. Denn bei genauerem Hinsehen verursachen beide KI-Modelle nach wie vor massive und gefährliche Probleme.