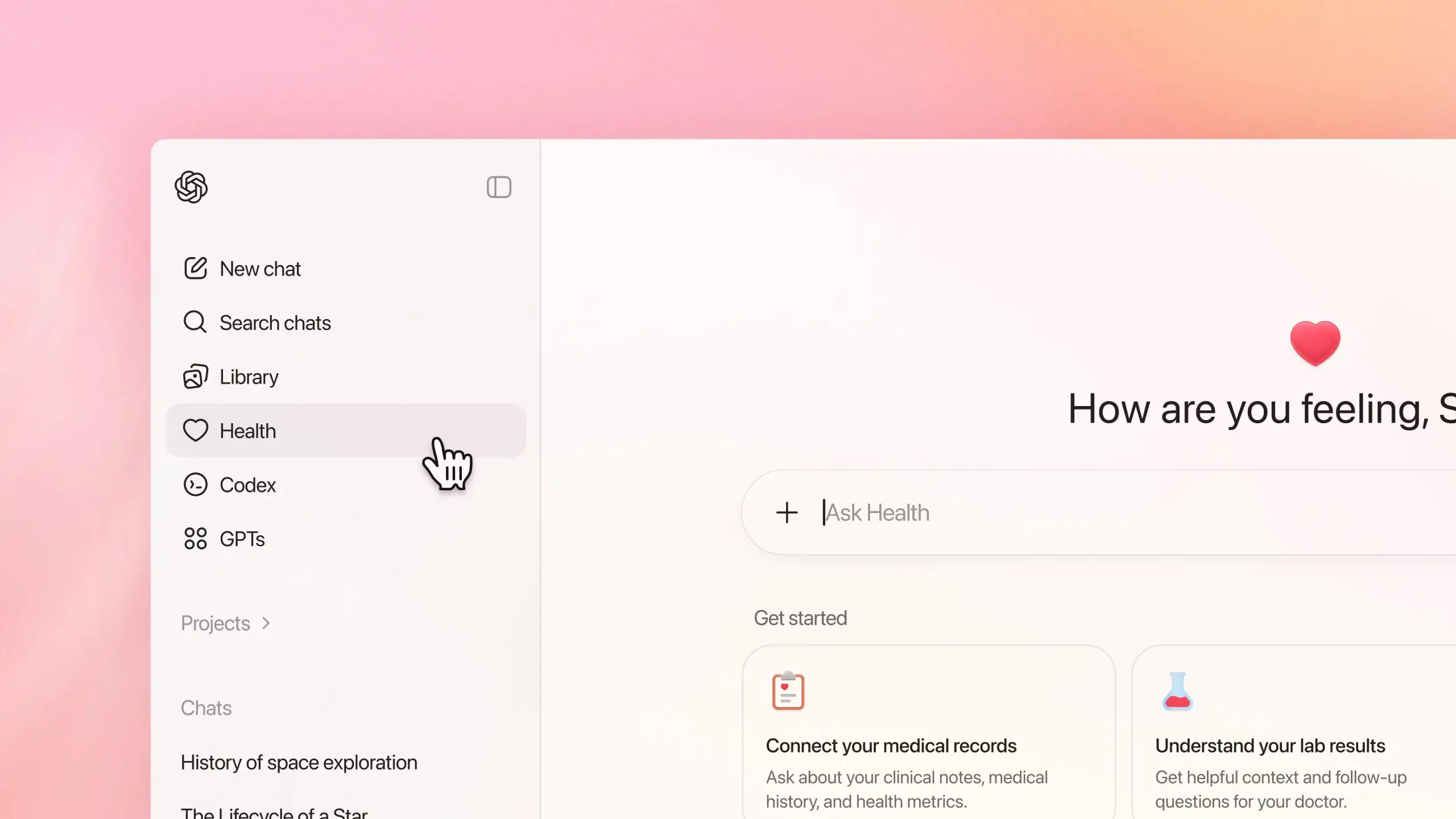

Laut OpenAI befragen 230 Millionen Menschen ChatGPT zu gesundheitlichen Themen – und das jede Woche. Gerade jetzt zum Jahresstart dürfte das Interesse an gesunder Ernährung und Fitness zudem besonders groß sein. Das hat das US-amerikanische Unternehmen zum Anlass genommen, um eine neue Funktion für seinen bekannten Chatbot vorzustellen: ChatGPT Health. Diese soll Nutzerinnen und Nutzern in Gesundheitsfragen beratend zur Seite stehen und abgegrenzt vom restlichen Bereich separat nutzbar sein.

Das bedeutet, dass es eine eigene Chathistorie für ChatGPT Health geben wird. Zudem sollen die dort verwendeten Daten nicht zum Training weiterer KI-Modelle genutzt werden. Das ist wohl auch aus Sicht des Datenschutzes nötig, da man wiederum zahlreiche andere Gesundheitsdienste anbinden können soll, um umfangreiche Nutzerdaten gewinnen zu können. Dazu gehören bekannte Anwendungen wie Apple Health oder WeightWatchers. Und auch seine medizinischen Unterlagen soll man künftig dort hochladen können, um sie analysieren zu lassen.

Um die sensiblen Gesundheitsdaten der Nutzerinnen und Nutzer dabei zu schützen, will OpenAI auf „speziell entwickelte Verschlüsselung und Isolierung“ setzen. Abseits des Datenschutz-Themas gibt es aber auch noch weitere Fragen zu ChatGPT Health. In der Vergangenheit gab es nämlich bereits einige Fälle, in denen Personen zu Schaden kamen, nachdem sie gesundheitliche Ratschläge von ChatGPT umgesetzt hatten.

ChatGPT Health soll ein umfangreicher KI-Assistent für die Gesundheit werden

So soll sich beispielsweise ein Nutzer mit Brom selbst vergiftet haben und sogar im Krankenhaus gelandet sein. Eine Studie ergab zudem, dass ChatGPT auch bei Informationen und Beratung zu Medikamenten oft danebenliegen würde. Diese – für das Unternehmen auch rechtlichen – Risiken sind offenbar auch OpenAI bewusst. Denn in der Mitteilung zur neuen Funktion ChatGPT Health wird explizit darauf hingewiesen, dass es „nicht für Diagnostik oder Behandlung gedacht“ sei. Das Tool soll stattdessen die medizinische Behandlung unterstützen und nicht ersetzen, indem es etwa Ratschläge zu Trainings- und Ernährungsplänen gibt.

Um mögliche KI-Halluzinationen zu verhindern, habe man zudem in den vergangenen Jahren mit mehr als 260 Ärztinnen und Ärzten zusammengearbeitet und zudem über 600.000 Mal Feedback zu Antworten erhalten. Gänzlich ausgeschlossen sind Fehler dadurch allerdings nicht. Deshalb gibt es bereits erste Stimmen von Expertinnen und Experten, die ebenfalls darauf hinweisen, dass man sich im Zweifel von medizinischem Fachpersonal beraten lassen und sich nicht einfach auf ChatGPT Health verlassen sollte. Das Thema mentale Gesundheit, bei dem viele ein besonders hohes Gefahrenpotenzial bei ChatGPT sehen, wird zudem in dem Beitrag des Unternehmens überhaupt nicht erwähnt.

Das Angebot soll zunächst für eine kleinere Testgruppe in den USA zur Verfügung stehen. Auf diese Weise soll ChatGPT noch getestet und verbessert werden, bevor es dann in weiteren Ländern ausgerollt wird. Wer interessiert ist, kann sich für eine Warteliste registrieren, die Nutzerinnen und Nutzern in der EU und dem UK allerdings nicht zur Verfügung steht.